La mésaventure d’Eric Eiswert, proviseur à Pikesville dans le Maryland, près de Washington, est devenue un cas d’école illustrant les dangers de l’IA. En pleine année électorale aux États-Unis, cette affaire a révélé la facilité avec laquelle cet outil peut être utilisé pour nuire.

Dangers de l’IA : diffusion d’une bande sonore falsifiée qui a fait polémique

Les dangers de l’IA montrent les défis auxquels les autorités doivent faire face pour contrer de telles pratiques. Après la diffusion de propos racistes attribués à Eiswert, provenant d’un enregistrement vocal falsifié, l’indignation a été intense au sein du lycée. Cette expérience vertigineuse a mis en lumière les dangers de l’IA, une technologie autrefois réservée à quelques-uns, mais désormais accessible à tous. Les autorités ont eu du mal à faire face aux dangers de l’IA, alors que l’enregistrement trafiqué est devenu viral sur les réseaux sociaux, propulsant l’école au cœur d’une polémique nationale.

Avancées technologiques : des lois sur l’intelligence artificielle s’imposent

Cette affaire liée au proviseur d’école a mis en évidence la vulnérabilité croissante de chacun face aux dangers de l’IA, comme l’a souligné Hany Farid, professeur à l’Université de Californie à Berkeley. Les menaces et les messages haineux ont afflué, forçant le proviseur à prendre des congés et à voir son domicile placé sous protection. Cette spirale de violence a révélé les profonds impacts personnels et les dangers de l’IA dans sa globalité. La vengeance a été révélée comme mobile, avec l’arrestation de Dazhon Darien, accusé d’être à l’origine de la falsification. Cette affaire a mis en évidence la nécessité d’adapter la loi aux avancées technologiques, comme l’a souligné le procureur local.

Lutte constante : des montages circulent pour nuire à diverses personnalités

Les lycées américains doivent déjà lutter contre d’autres dangers de l’IA, qui a engendré des vagues de harcèlement et de diffusion d’images pornographiques. Les montages audio, en particulier, sont difficiles à détecter, comme en témoigne l’incident où la voix du président Joe Biden a été usurpée pour influencer les électeurs. À Pikeville, cette affaire qui met en avant les dangers de l’IA a secoué la communauté, suscitant des interrogations sur la sécurité de chacun face à de telles attaques potentielles. Le cas d’Eiswert est devenu un avertissement clair des dangers de l’IA déjà omniprésents dans un monde de plus en plus connecté et technologiquement avancé.

Avec ETX DailyUp

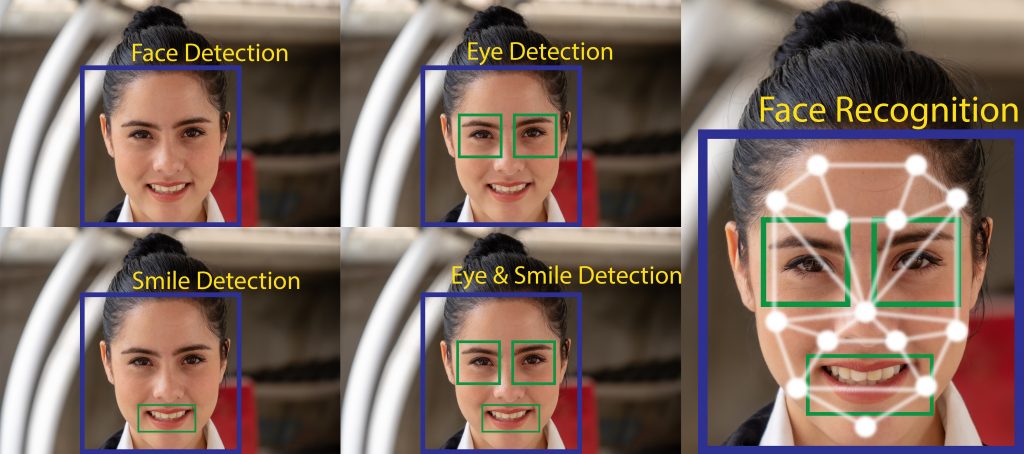

]]>Les deepfakes, ces faux contenus sous forme de photos et de vidéos, se répandent rapidement en ligne. Les jeunes savent comment les reconnaître, mais s’inquiètent de plus en plus à propos des répercussions de ces trucages générés par l’IA. Ils craignent pour leur réputation et leur vie privée.

Les deepfakes se répandent sur Internet

La technologie moderne et l’essor des réseaux sociaux facilitent la diffusion des deepfakes. Ces hypertrucages générés par l’intelligence artificielle se répandent rapidement sur la toile, créant la confusion chez certains internautes. Une enquête initiée par Alucare.fr démontre pourtant que sept Français sur dix savent ce que sont ces faux contenus. Ce sont surtout les jeunes de 18 à 34 ans qui sont familiarisés avec ces trucages. Les choses se compliquent lorsqu’il s’agit de les distinguer dans une masse d’autres photographies réelles. Dans ce cas, seul un Français se dit capable de différencier une image réelle d’un deepfake. Chez les jeunes, 55% des 18-24 ans disent avoir cette compétence et 48% chez les 25-34 ans.

L’inquiétude des jeunes face à ces fausses photographies et vidéos

Face à la viralité de ces faux contenus sur Internet, les jeunes se disent de plus en plus inquiets. Ils redoutent la facilité à laquelle il est possible actuellement de réaliser ces trucages à partir d’une simple photo. L’enquête révèle ainsi que les deux tiers des 18-24 ans ont peur d’être, un jour, victimes de ces vidéos et photographies falsifiées. Les adolescentes sont celles qui s’inquiètent le plus à cause de la tendance des trucages de photos dénudées. Cette anxiété est tout à fait compréhensible, dans la mesure où ce sont surtout ces jeunes filles qui sont la cible des fausses photos sur les réseaux sociaux. Les créateurs de ces hypertrucages n’hésitent pas faire chanter leurs cibles en les menaçant de publier ces faux contenus si elles ne leur paient une somme d’argent.

Ces faux contenus peuvent constituer une menace pour la réputation

Si les jeunes redoutent autant le deepfake, c’est parce qu’ils peuvent imiter presque parfaitement le comportement humain. Leur hyperréalisme est tel, qu’un œil non averti peut les confondre avec de vraies vidéos ou photos. Résultat : ces faux contenus peuvent ruiner la vie des personnes dont ils reprennent l’image. Effectivement, les créateurs fabriquent des photos et des vidéos à caractère pornographique pour faire chanter leurs victimes. La plupart d’entre elles sont d’ailleurs des femmes, qu’elles soient des personnalités connues ou pas. Des célébrités, comme Taylor Swift et Léna Situations font partie de celles qui ont été prises dans la tourmente de ces trucages.

L’intelligence artificielle simplifie la création des hypertrucages

L’avancée de l’intelligence artificielle (IA) a considérablement simplifié la production des trucages. La propagation de ces faux contenus falsifiés découle en grande partie de la facilité d’accès aux outils de création. Une chercheuse spécialisée en IA a souligné qu’il est désormais envisageable de concevoir un deepfake avec un simple smartphone et un budget modeste. Cette accessibilité accrue a favorisé une diffusion généralisée de ces pratiques. En effet, les avancées de l’IA générative permettent aujourd’hui de générer des images, des sons et des vidéos à partir de requêtes simples. L’inquiétude grandissante face au deepfake est donc bel et bien justifiée puisque les outils sont accessibles au grand public.

La difficile lutte contre le deepfake

La lutte contre les deepfakes, qui sont une véritable menace pour l’identité, la vie privée et la réputation, est un défi complexe. La justice se trouve souvent désarmée, confrontée à une pénurie de ressources. Déposer une plainte peut s’avérer fastidieux, avec des commissariats parfois réticents à l’enregistrer. Même en cas d’acceptation, l’enquête peut rapidement être entravée par des obstacles techniques majeurs. Retrouver l’adresse IP de l’auteur est complexe, surtout si cette adresse a été partagée ou si le compte a été désactivé. De plus, si l’auteur ou la plateforme se trouvent à l’étranger, toute démarche légale devient quasiment impossible. Le problème central réside dans le manque de moyens, de personnel et de formation au sein de la justice pour aborder efficacement ces questions.

Avec ETX/DailyUp

]]>

La marque à la pomme se lancerait dans la robotique avec un futur robot domestique Apple. Après avoir tiré un trait sur la voiture, la société pourrait se lancer dans la robotique, avec une sorte de super assistant intelligent, capable de suivre son utilisateur et de répondre à de nombreux besoins.

Robot domestique Apple : un projet de robotique pour la maison et le bureau

Selon Bloomberg, la société américaine travaillerait sur le développement d’un robot domestique Apple. Il s’agirait en quelque sorte d’un assistant intelligent capable de vous suivre partout dans la maison, ou au bureau, pour vous aider dans vos différentes tâches au fil de la journée. Aucune confirmation ni même information n’a encore filtré de l’entreprise sur ce projet de robot domestique Apple. Cependant, le dispositif pourrait combiner plusieurs technologies de pointe, de la reconnaissance vocale à l’intelligence artificielle.

Super assistant intelligent : un automate doté d’une intelligence artificielle

En termes d’usages, un tel robot domestique Apple pourrait notamment aider les personnes âgées ou celles à mobilité réduite en leur préparant leurs médicaments. Ce robot domestique Apple pourrait également apporter de la nourriture, mais aussi discuter de manière intelligente grâce à l’IA. Pour les enfants, ce super assistant intelligent pourrait servir de compagnon interactif, pour jouer ou réviser, selon leur âge. Le robot domestique Apple pourrait aussi servir d’agent de sécurité en l’absence des propriétaires d’un logement et donner l’alerte en cas d’intrusion ou d’incendie, ou bien encore gérer l’ensemble des produits connectés du foyer. Il serait le robot domestique Apple par excellence si le projet se concrétise.

Innovation technologique : une initiative qui évoque Astro d’Amazon

À défaut de produire un jour sa propre voiture, la firme créée par Steve Jobs se tournerait donc vers la robotique avec son robot domestique Apple. Sur le papier, ce modèle du géant américain n’est pas sans rappeler Astro d’Amazon, le petit automate d’un autre titan de la tech. Dès 2021, sous ses faux airs de Wall-E, cet automate aussi se destinait à aider les gens dans leur quotidien. Seulement voilà, il n’a jamais trouvé son public, malgré la force de frappe d’Amazon. Récemment, Amazon l’a même recyclé en agent de sécurité pour les entreprises. Reste à voir si la version de la marque à la pomme pourra faire mieux et trouver preneur, même dopé à l’intelligence artificielle. Si le projet Titan n’a pas vu le jour, on espère mieux pour ce robot domestique Apple.

Avec ETX DailyUp

]]>L’immobilier IA apporte son lot d’innovations technologiques dans ce secteur réputé pour son conservatisme. Actuellement, l’usage de cette technologie est loin d’être généralisé, mais elle amènera divers avantages aussi bien pour les habitants que pour les agences immobilières.

Immobilier IA : des innovations technologiques présentées au salon mondial de la profession

Le salon mondial de la profession s’est tenu à Cannes, dans le sud-est de la France. Pour l’occasion, de nombreuses entreprises ont présenté leurs innovations technologiques, notamment en matière d’immobilier IA. Des sociétés soulignent l’importance de recourir à l’intelligence artificielle dans ce secteur pour rester compétitif. Les petites entreprises comme les grandes et particulièrement, les sociétés foncières résidentielles, qui sont présentes le plus souvent aux USA, gagnent à l’utiliser pour leur fonctionnement. En effet, même si les professionnels sont conscients de ses avantages, certains estiment que le secteur n’exploite pas assez cette technologie par rapport aux autres.

Un outil exploitable pour optimiser la performance énergétique des bâtiments

L’intelligence artificielle est utilisée depuis des années pour gérer les paramètres énergétiques des bâtiments. Ce sont surtout les foncières de bureaux qui y ont recours pour automatiser cette tâche. Elles l’utilisent par exemple pour anticiper le chauffage dans certaines salles, piloter le chauffage de manière qu’il soit connecté aux prévisions météo, adapter la température, etc. Les dispositifs utilisés pour gérer l’aspect technique des bâtiments et qui intègrent l’intelligence artificielle garantissent plus de finesse et d’automatisation dans l’administration technique. Ils sont également efficaces pour repérer à temps lorsqu’un équipement n’est plus performant. Ils garantissent ainsi une meilleure maintenance de l’équipement électrique, du matériel de chauffage, de climatisation, etc.

Une solution pour améliorer la gestion immobilière

Aujourd’hui, des entreprises proposent aussi des innovations technologiques basées sur l’intelligence artificielle aux administrateurs de biens immobiliers. Tel est le cas de la société danoise Propbinder, qui propose à ses clients de faciliter la gestion immobilière en utilisant l’intelligence artificielle. Les gestionnaires peuvent y recourir pour automatiser l’orientation des offres, la recherche d’informations dans les contrats de location, l’information sur les caractéristiques d’un bien, etc. L’outil intelligent est aussi utile pour l’analyse des masses de données publiques, pour l’estimation de la demande dans les meilleurs quartiers, l’ajustement des loyers par rapport aux prix du marché… Grâce à l’intelligence artificielle, les gestionnaires communiquent mieux avec leurs clients et en plus, ils gagnent aussi du temps.

L’intelligence artificielle facilite l’estimation de la valeur des biens immobiliers

L’un des avantages majeurs de l’utilisation de l’intelligence artificielle dans les agences immobilières réside dans sa capacité à affiner les estimations de prix des biens immobiliers. Contrairement aux méthodes traditionnelles, cette technologie exploite le machine learning pour considérer une multitude de facteurs. Cette approche permet une estimation plus précise, prenant en compte des éléments tels que la présence d’un balcon, l’exposition au soleil, et bien d’autres encore. En analysant de vastes ensembles de données, l’intelligence artificielle offre une compréhension plus approfondie de l’impact de chaque paramètre sur la valeur d’un bien. Ainsi, les estimations sont plus précises et mieux informées, améliorant ainsi l’expérience globale client lors des transactions immobilières.

Quid de l’avenir des professionnels ?

À mesure que l’intelligence artificielle continue de se développer, les professionnels du secteur sont confrontés à un avenir transformé. La clé réside dans une combinaison intelligente entre l’expertise humaine et les capacités de l’outil en matière de gestion immobilière, de recherche de biens, de service client, etc. En intégrant cette technologie de manière stratégique, les professionnels peuvent offrir des services de qualité supérieure et répondre aux attentes changeantes des consommateurs. Il est important de noter que l’intelligence artificielle n’est pas une solution en soi. Elle doit être considérée comme un outil puissant qui, utilisé judicieusement, contribue à transformer positivement le secteur.

Avec ETX/DailyUp

]]>L’industrie pharmaceutique fait partie de ces secteurs qui se retrouveront bouleversés par l’intelligence artificielle. Les biotechs et autres start-ups se lancent, en effet, dans le développement de médicaments issus de l’IA, et cela se répercutera sur le métier du chimiste à l’avenir.

Les biotechs s’intéressent à la conception de médicaments issus de l’IA

De plus en plus de projets de conception de médicaments issus de l’IA émergent des biotechs et des start-ups à l’heure actuelle. C’est le cas par exemple de la start-up Ikptos, qui utilise l’intelligence artificielle pour développer des traitements dans le domaine de la cancérologie en France. Elle ambitionne de réduire de moitié le temps nécessaire à la découverte d’un candidat-médicament pré-clinique n’ayant pas été testé chez les humains. Il convient de noter, en effet, que la mise au point d’un nouveau médicament requiert deux fois plus de temps que la construction d’un avion ! Cette réalité démontre à quel point l’usage de la technologie intelligente pourrait révolutionner ce secteur.

Une solution pour gagner du temps dans l’industrie pharmaceutique

Traditionnellement, le développement d’un médicament nécessite l’identification des composés chimiques dotés des caractéristiques idéales pour produire l’effet thérapeutique visé. Ensuite, il faut passer par la phase de développement chimique clinique qui voit le test du candidat médicament sur les humains. En temps normal, cette étape s’étend sur cinq années et requiert dans le même temps un investissement de 100 millions de dollars par candidat-médicament en moyenne. Grâce à l’intelligence artificielle, il sera possible de sauter toutes ces étapes. Toutefois, il n’existe pas encore de point de comparaison des projets traditionnels avec ceux réalisés à l’aide de cette technologie.

Un robot intelligent remplacera-t-il le chimiste à l’avenir ?

Chez Iktos, on espère révolutionner l’industrie pharmaceutique grâce à des solutions d’intelligence artificielle modernes. Il s’agit de robots alimentés par l’intelligence artificielle qui serviront entre autres, à imaginer la molécule adéquate. Ils aideront aussi à suggérer la recette idéale sur la base de publications de millions de réactions chimiques et de données de brevets. Un autre robot, quant à lui, aura la tâche de produire et de synthétiser 96 molécules à la fois. Tout ce travail est réalisé habituellement par une trentaine de chimistes en laboratoire. Grâce aux solutions intégrant l’intelligence artificielle, ce professionnel pourra se concentrer sur d’autres tâches à valeur ajoutée autrement plus productives pour le laboratoire.

D’autres avantages de l’usage des intelligences artificielles génératives dans ce domaine

Outre le gain de temps considérable qu’elle offre, l’utilisation de l’intelligence artificielle par les biotechs permet une détection précoce et précise des interactions médicamenteuses potentielles. Grâce à des algorithmes sophistiqués, elle analyse les bases de données médicales pour identifier des combinaisons qui pourraient présenter des risques d’interactions indésirables. En exploitant des modèles prédictifs, elle réduit aussi les coûts associés à la découverte de nouvelles thérapies. Enfin, l’intelligence artificielle générative permet aux professionnels de santé de personnaliser les protocoles thérapeutiques en fonction des caractéristiques individuelles des patients.

ChatGPT est pourtant un mauvais assistant pour les pharmaciens

Si l’utilisation du robot qui intègre une intelligence artificielle peut être l’avenir de la pharmacothérapie, on ne peut pas encore en dire autant de ChatGPT. Une étude menée par le College of Pharmacy de l’Université de Long Island a démontré que l’agent conversationnel a fourni des réponses incorrectes ou incomplètes dans 73 % des cas, en réponse à des questions posées sur des traitements. Ces résultats soulèvent des inquiétudes quant à la fiabilité de la version gratuite de ChatGPT en tant qu’outil d’assistance pour les pharmaciens. Ils révèlent aussi les limites actuelles de l’intelligence artificielle en matière de conseils précis sur les traitements médicamenteux.

Avec ETX/DailyUp

]]>Les faux nus créés par IA ou deepfakes pornographiques envahissent la toile et aux États-Unis, ce sont les adolescentes américaines qui en pâtissent. Ces montages photo particulièrement réalistes sont de plus en plus faciles à produire avec la démocratisation de l’intelligence artificielle.

Les faux nus créés par IA circulent beaucoup sur les réseaux sociaux

Les progrès de l’intelligence artificielle et surtout la popularisation de son usage auprès du grand public mènent à certaines dérives. La création des deepfakes pornographiques en fait partie, et fait des victimes, surtout auprès des adolescentes américaines. Ces faux nus créés par IA sont en réalité, des montages photo ou vidéo hyperréalistes à caractère pornographique, souvent utilisés pour harceler les victimes ou pour les humilier. Ce fut le cas, par exemple, d’une collégienne Texane appelée Ellis, âgée de 14 ans, dont les fausses photographies la montrant dénudée, ont été partagées sur Snapchat. Il s’avère que nombreuses de ses camarades ont aussi été la cible de cet acte malveillant.

L’intelligence artificielle facilite la création de ces montages photo ou vidéo

La création de deepfakes pornographiques et leur mise en circulation à des fins de vengeance, d’humiliation ou de harcèlement est de plus en plus fréquent aux USA. Une enquête est d’ailleurs ouverte après que de tels contenus ont été découverts dans un lycée du New Jersey en octobre. Leur prolifération s’explique par la facilité à laquelle il est possible d’accéder aux programmes de création. Une chercheuse en intelligence artificielle précise qu’il suffit d’un smartphone et de quelques dollars pour fabriquer un deepfake. L’intelligence artificielle générative est désormais en mesure de produire des images, des sons et des vidéos à partir d’une simple requête.

La législation est dépassée face à la menace de ces contenus à caractère sexuel

Les adolescentes américaines victimes de ces fausses images à caractère sexuel ont beau être traumatisées, elles ne sont pas pour autant bien protégées par les systèmes scolaires et judiciaires. Aux USA, le fait de fabriquer et de transmettre ce genre de contenus ne fait l’objet d’aucune sanction fédérale. Par ailleurs, seuls quelques États ont légiféré spécifiquement sur ce sujet. Face à la situation actuelle, le président américain Joe Biden a appelé les législateurs à empêcher l’usage de l’intelligence artificielle générative pour fabriquer des contenus pédocriminels ou intimes non consentis par les personnes réelles. À cet effet, il demande à ce que des limites et des protections soient fixées.

Quid de la responsabilité des éditeurs et des plateformes ?

La prolifération alarmante des deepfakes sexuels sur les réseaux sociaux, mettant en scène des adolescentes américaines, soulève des préoccupations croissantes quant à la protection de la vie privée et à la sécurité en ligne. Cependant, au-delà des individus malveillants qui exploitent ces technologies, la responsabilité des entreprises qui fournissent ces outils et des réseaux sociaux en tant que canaux de diffusion doit être scrutée de près. Des mesures de sécurité renforcées, telles que des algorithmes de détection avancés, pourraient contribuer à limiter la propagation de ces contenus néfastes. Les entreprises doivent également coopérer avec les autorités pour enquêter sur les cas signalés et prendre des mesures légales contre les individus responsables.

Les victimes doivent être accompagnées psychologiquement

Ces attaques sous forme de contenus altérés par l’intelligence artificielle devenus malheureusement courantes peuvent avoir des conséquences dévastatrices sur la santé mentale des victimes. Les ados qui se retrouvent piégés dans ce type de cyberharcèlement peuvent développer un stress post-traumatique, des symptômes d’anxiété sévère, des crises de panique et même sombrer dans la dépression. Dans de tels cas, le soutien psychologique professionnel est primordial. Les victimes ont besoin d’un espace sécurisé pour exprimer leurs émotions, comprendre et traiter les traumatismes subis.

Avec ETX/DailyUp

]]>L’avènement de l’intelligence artificielle offre de nombreuses opportunités pour les humains à l’heure actuelle. Les chercheurs voient dans cette technologie un moyen de gagner en productivité dans l’entreprise, et même de pouvoir passer à la semaine de quatre jours, dans un futur proche.

Les IA génératives conduiront-elles les travailleurs vers la semaine de quatre jours ?

Les entreprises seraient-elles bientôt en mesure de proposer la fameuse semaine de quatre jours pour leurs employés ? L’intelligence artificielle pourrait rendre cela possible, selon deux études récemment publiées par le Think tank Autonomy sur l’impact de l’usage de l’intelligence artificielle sur les mains d’œuvre britannique et américaine. Les experts y affirment que 28% des travailleurs britanniques pourraient passer de 40 à 32 heures de travail d’ici l’année 2033. En d’autres termes, ils pourraient diminuer leur temps de travail hebdomadaire d’une journée, sans voir leur salaire diminuer. Les chercheurs pensent que cela peut être possible aussi pour 35 millions d’Américains.

Les grands modèles de langages permettraient de gagner en productivité

L’utilisation de l’intelligence artificielle générative, mais également les modèles de langage ou LLM dans le quotidien professionnel des travailleurs leur permettrait aussi d’être plus productifs. Les études précisent même que 71% des actifs aux USA et 88% des Britanniques pourraient réduire leur temps de travail de 10% grâce aux LLM. Ces technologies leur garantiraient des gains de productivité en leur épargnant les tâches répétitives et chronophages. Grâce au temps gagné, ils pourront aussi se focaliser plus sérieusement sur les missions à forte valeur ajoutée qui leur sont confiées. Dans le même temps, ces outils pourraient contribuer à baisser le taux de chômage de masse et les troubles mentaux liés au travail ainsi que les troubles physiques associés au surmenage.

Des outils de travail qui causent des soucis de créativité

Si le déploiement des IA génératives et les LLM sont une solution qui permet aux travailleurs d’améliorer leurs performances, les experts pointent aussi du doigt certaines limites de ces outils. Des chercheurs américains ont mené une expérience scientifique auprès de 750 salariés qui ont utilisé la nouvelle génération d’intelligence artificielle. Ils ont pu constater que l’usage de ces outils ont effectivement facilité les tâches comme la rédaction d’emails, la recherche d’une dénomination pour un produit ou un service ou encore la synthèse de documents. Toutefois, ils sont moins performants pour la résolution de problèmes complexes et limiteraient la créativité des utilisateurs.

Il est important de ne pas dépendre de ces technologies intelligentes

Dans un contexte où l’intelligence artificielle et les grands modèles de langage deviennent de plus en plus omniprésents dans le milieu professionnel, il devient impératif de ne pas créer une dépendance excessive à la machine. Cette utilisation croissante pourrait provoquer de la « flânerie sociale ». Selon ce concept, les individus ont tendance à diminuer leurs efforts au sein d’un groupe, de manière proportionnelle à la taille de celui-ci. Ainsi, les interactions homme-robot pourraient induire une diminution des efforts humains dans le cadre professionnel. Il est crucial de veiller à ce que les travailleurs ne deviennent pas excessivement dépendants des machines. Cette vigilance vise à garantir une collaboration qui ne compromet ni la productivité et ni l’efficacité des équipes.

Une technologie qui menace tout de même de nombreux emplois

L’émergence de l’intelligence artificielle offre des opportunités considérables en matière de productivité, mais elle représente également une menace tangible pour de nombreux emplois. Selon une étude récente, jusqu’à 800 000 emplois sont susceptibles d’être menacés en France en raison de l’automatisation induite par ces outils. Cette menace ne se limite pas à un secteur particulier, touchant une variété de professions avec des degrés de transformation très hétérogènes. Il est devenu crucial pour les acteurs du marché du travail de reconnaître que peu de métiers resteront totalement à l’abri de l’influence de cette nouvelle technologie.

Avec ETX/DailyUp

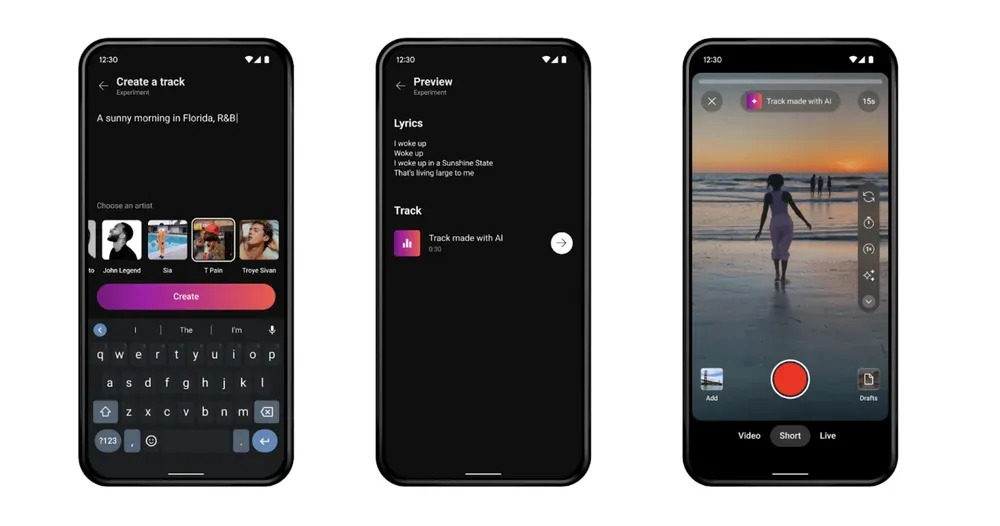

]]>L’intégration de l’intelligence artificielle est devenue une pratique courante sur les plateformes, pour assurer une expérience optimale aux utilisateurs. Meta et Youtube ne sont pas en reste et dévoilent les nouveaux outils basés sur l’IA qui seront disponibles à l’utilisation pour le public.

Emu Video et Edit, les nouveaux outils basés sur l’IA de Facebook et Instagram

Le groupe Meta, anciennement connu sous le nom de Facebook vient de présenter ses deux nouveaux outils basés sur l’IA qui serviront à la création et à l’édition des vidéos ainsi que des visuels avec des prompts. Il s’agit respectivement d’ « Emu Video » et d’ « Emu Edit ». Le premier outil permettra plus précisément de créer des clips en utilisant du texte et des images en utilisant une approche factorisée. Elle garantit des vidéos de 512×512 de quatre secondes. Emu Edit, quant à lui, simplifie la création de visuel, puisque l’utilisateur n’a qu’à rédiger un prompt décrivant le résultat attendu. Il faut noter que ces nouveautés ne sont pas encore disponibles, Meta n’ayant pas encore précisé de date précise pour leurs sorties.

Dream Track pour faciliter la création de musique

Meta n’est pas la seule plateforme à miser sur l’intelligence artificielle pour perfectionner ses fonctionnalités. La plateforme de vidéos YouTube exploite aussi cette technologie, notamment avec son nouvel outil appelé Dream Track. Il permet aux utilisateurs de composer une musique en utilisant le style d’un artiste parmi de nombreux choix. On compte aujourd’hui neuf artistes qui ont collaboré avec cette plateforme afin qu’un groupe de créateurs sélectionnés puissent créer des bandes sons uniques de 30 secondes. Le résultat est une bande sonore originale utilisant une voix de l’artiste sélectionné qui a été générée par l’intelligence artificielle, utilisable dans un Short.

Le nouvel outil de YouTube inquiète les maisons de disque

Le fait que les créateurs puissent utiliser l’intelligence artificielle sur YouTube pour créer des bandes sons peut poser un problème pour les maisons de disque. De son côté, la plateforme précise qu’elle s’engage à continuer collaborer avec ces professionnels de la musique en veillant à explorer les nouvelles opportunités offertes par cette technologie. Dans ce cadre, elle compte développer des contrôles, des cadres d’attribution raisonnables et durables ainsi qu’une monétisation. YouTube affirme aussi que son nouvel outil n’est que la première étape de cette démarche et qu’il envisage de faire évoluer progressivement son approche.

Les entreprises exploitent à fond l’intelligence artificielle générative

Les entreprises manifestent un intérêt croissant pour le marché émergent de l’intelligence artificielle générative, notamment depuis le lancement de ChatGPT d’OpenAI. Elles reconnaissent son potentiel révolutionnaire pour développer de nouvelles capacités et optimiser les processus commerciaux. Cette technologie, qui utilise des modèles d’apprentissage profond pour générer du contenu, offre des opportunités significatives dans divers secteurs. Les entreprises cherchent à exploiter l’intelligence artificielle pour créer du contenu créatif, développer des prototypes virtuels, et automatiser des tâches complexes. Cela permet non seulement d’accroître l’efficacité opérationnelle, mais aussi d’explorer de nouvelles façons d’interagir avec les clients et de stimuler l’innovation dans le domaine.

Les organisations associent cette technologie à un risque pour la sécurité

Bien que 95 % des organisations intègrent déjà des outils basés sur l’intelligence artificielle générative tels que ChatGPT ou Emu Video ou Edit dans leurs opérations, une récente étude révèle que 89 % d’entre elles considèrent ces technologies comme un risque potentiel pour la sécurité. Les risques identifiés comprennent la génération de contenus malveillants ou trompeurs ou deepfakes, la diffusion de désinformations automatisées, et même la possibilité d’exploitation par des acteurs malveillants. Cette situation paradoxale témoigne de la nécessité de développer des mécanismes de sécurité robustes pour atténuer ces diverses menaces.

Avec ETX/DailyUp

]]>Les professionnels de l’édition se sont réunis récemment au Salon de Francfort qui est la plus grande Foire du livre au monde. L’une des discussions qui en est ressorti concerne l’intelligence artificielle et l’apparition des contenus générés par l’ordinateur, qui inquiètent certains auteurs.

Les acteurs de l’édition ressentent de l’insécurité face à l’IA

Réunis dans le cadre du Salon de Francfort, les acteurs de l’édition ont exprimé leur inquiétude face à l’utilisation des IA génératives dans ce secteur. Il s’agit d’une véritable révolution technologique qui bouleverse actuellement l’industrie du livre, car des nouveaux contenus, entièrement générés avec l’IA apparaissent et sont même proposés à la vente sur les plateformes telles qu’Amazon. Même si certains restent sceptiques quant à leur qualité, il n’en demeure pas moins que beaucoup s’interrogent sur la propriété intellectuelle des auteurs. Les domaines touchés sont la traduction, les éditions scientifiques et juridiques et dans une moindre mesure, la création littéraire.

Une aide à l’écriture surtout pour les romans à l’eau de rose

Le recours à l’intelligence artificielle pour écrire des romans ne convainc pas encore des auteurs comme Salam Rushdie. Effectivement, les performances de l’IA restent médiocres selon ce dernier et ses pairs, en raison de son manque d’inspiration. Le directeur de la Foire, Juergen Boos, quant à lui, pense que cette technologie peut être utilisée comme d’aide à l’écriture pour les romans ayant un modèle narratif stéréotypé et destiné à une masse. C’est le cas notamment des romans à l’eau de rose. Le secteur des ouvrages scientifiques et spécialisés a également étudié plus sérieusement la question. Preuve s’il en est que l’impact de l’IA pourra dépendre du type de publication, au final.

La question des droits d’auteur inquiète les professionnels

Le fonctionnement des IA génératives repose sur des algorithmes qui s’entraînent avec des milliards de textes existants émanant d’auteurs bel et bien réels. Résultat : il y a un flou en ce qui concerne les droits d’auteur des contenus générés par l’IA, et cela suscite de l’inquiétude. Le fait est que de grosses sommes sont en jeu et cela peut poser problème. L’écrivain George R.R Martin, par exemple, fait partie des écrivains qui se sont insurgés contre cette pratique. Ce dernier a saisi la justice américaine contre OpenAI, à qui ils reprochent de s’être basé sur leur travail pour la création de ChatGPT. Ils estiment de la start-up n’a pas respecté leurs droits d’auteur.

Les éditeurs européens souhaitent une réglementation plus stricte

Les éditeurs européens ont récemment exprimé leur préoccupation quant à la régulation des intelligences artificielles génératives dans le secteur de l’écriture de romans et autres œuvres littéraires. Le Parlement européen a déjà proposé des obligations de transparence pour les modèles de fondation, tels que ChatGPT ou Bard, pour garantir qu’ils fournissent un résumé détaillé des œuvres protégées par les droits d’auteur utilisées pour leur formation. Cependant, le Conseil des écrivains européens n’est pas satisfait par cette réforme et juge qu’elle est insuffisante en termes de réglementation. Il a ainsi mis en avant diverses recommandations visant à renforcer les législations.

Certains auteurs souffrent d’une baisse de leurs revenus

La guerre littéraire qui oppose les auteurs et l’intelligence artificielle concerne aussi la baisse de revenus qu’entraîne l’usage de cette technologie comme aide à l’écriture ou comme auteur. L’avènement de ces outils rend encore plus complexe la génération de revenus en particulier pour les auteurs novices et les membres de communautés sous-représentées. Face à cette menace, ils réclament alors une rétribution financière de la part des acteurs de l’intelligence artificielle générative qui utilisent leur travail. Ils insistent également sur le fait que les éditeurs d’IA générative doivent obtenir le consentement formel des auteurs de livres avant d’utiliser leurs œuvres littéraires.

Avec ETX/DailyUp

]]>Le mail est un moyen de communication incontournable dans le milieu professionnel. Pourtant, la rédaction des mails professionnels demeure une tâche fastidieuse pour les salariés. Raison pour laquelle les entreprises recourent désormais à l’intelligence artificielle pour rédiger les e-mails.

Des entreprises aident les salariés à la rédaction de mails professionnels avec l’IA

La rédaction et la gestion des mails professionnels sont des tâches particulièrement chronophages. Elles peuvent empiéter beaucoup sur le temps de travail des salariés et c’est pourquoi des entreprises ont adopté l’IA à travers des plateformes comme Warmer.ai afin de fournir une assistance à leurs employés. Cette technologie facilite la personnalisation du courriel professionnel, puisqu’il suffit de préciser l’objectif du mail et de fournir les informations sur du destinataire à partir d’un profil LinkedIn, un tableur Excel ou un site web. Ces données permettent à la plateforme de rédiger un mail qui précise l’objet du message dans son contenu et qui inclut tous les destinataires lorsque cela est nécessaire.

Copilote Microsoft 365 accompagne les travailleurs

La tendance de l’utilisation de l’intelligence artificielle pour faciliter les tâches des salariés s’observe aussi dans les grandes sociétés. La multinationale de Bill Gates compte, par exemple, intégrer copilote Microsoft 365 à ses systèmes comme Windows 11. Cette intégration permettra aux utilisateurs de rédiger facilement et rapidement des emails concis, clairs et même dans un langage inclusif si besoin, afin de produire un résultat soigné et professionnel. L’outil basé sur l’IA est aussi censé garantir le minimum d’erreur dans le courriel. Grâce à ces fonctionnalités, il assurera l’accompagnement des travailleurs dans leurs missions quotidiennes. Cette intégration est prévue pour être déployée auprès des entreprises en novembre 2023.

Une solution pour lutter contre l’hyperconnectivité et l’hyperréactivité

Le déploiement des outils de rédaction d’e-mails comme Copilote Microsoft 365 et Warmer.ai est aussi un moyen de lutter contre l’injonction à l’hyperréactivité et à l’hyperconnectivité qu’implique la gestion des e-mails. En effet, les salariés peuvent rapidement être submergés par les nombreuses sollicitations en entreprise, qui comprennent à la fois les emails, mais aussi les notifications et autres invitations émanant des différents outils numériques. Ils se sentent obligés d’y répondre continuellement, même en dehors de leur temps de travail, pour ne pas paraître mal organisés. Pourtant, cela demande beaucoup de temps et d’efforts et peut, sur le long terme, être nuisible à leur bien-être mental en engendrant de l’anxiété et du stress.

Quand la gestion d’email nuit au bien-être au travail

Selon une étude publiée par l’American Psychological Association, le fait de consulter régulièrement ses emails en dehors des heures de travail est lié à des niveaux plus élevés de stress et d’insatisfaction professionnelle. Les salariés se sentent souvent contraints de répondre immédiatement aux messages, ce qui perturbe leur temps personnel et nuit à l’équilibre entre vie professionnelle et vie personnelle.

L’Université de Californie, Berkeley, a également mené des recherches montrant que l’hyperconnectivité due aux emails peut entraîner une détérioration de la santé mentale. Effectivement, les employés se sentent constamment sous pression pour rester disponibles. Cette tendance peut aboutir à une baisse de la productivité, car les employés n’ont pas le temps de souffler.

De l’importance de la déconnexion après les heures de bureau

Le droit à la déconnexion est un aspect crucial de la législation du travail visant à préserver le bien-être des employés en allégeant la pression de l’hyperréactivité. Selon les dispositions de la loi française, l’employeur a le devoir de respecter le droit des salariés à se déconnecter en dehors de leurs heures de travail. Cela peut être réalisé en instaurant des politiques internes qui encouragent le respect de cette liberté fondamentale. Une approche efficace consiste à définir des créneaux horaires spécifiques où les employés ne sont pas tenus de répondre aux emails ou aux appels du bureau. Les entreprises peuvent aussi encourager les cadres à encourager une culture de respect de la vie personnelle.

Avec ETX/DailyUp

]]>